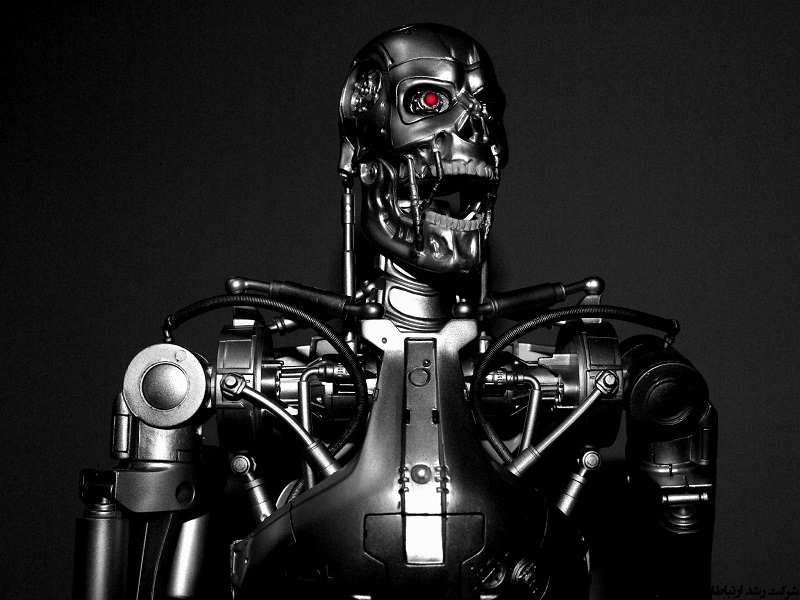

تحریم دانشگاه کره جنوبی به دلیل نگرانی از ساخت روبات قاتل

به گزارش خبرگزاری رویترز، این کارشناسان و پژوهشگران که از ۳۰ کشور مختلف هستند گفتهاند از این پس از این دانشگاه یا موسسه علوم و فناوری پیشرفته که به نام کایست (KAIST) شناخته میشود بازدید نخواهند کرد، پژوهشگران آن را نخواهند پذیرفت و با برنامه پژوهش آن نیز همکاری نخواهند کرد.

پژوهشگران در این موضعگیری خود بر پرهیز از تولید هوش مصنوعی تسلیحاتی بدون کنترل واقعی انسان تاکید میکنند. نگرانی اصلی پژوهشگرانی که این بیانیه را امضا کردهاند نبود کنترل واقعی انسان بر تسلیحاتی است که با هوش مصنوعی کار میکند.

در بخشی از این بیانیه گفته میشود: «در صورت تولید تسلیحاتی که بدون کنترل انسان و به طور مستقل کار میکنند شرایط برای تسریع و گسترش جنگ در ابعاد بیسابقهای فراهم خواهد شد. آنها به طور بالقوه میتوانند به ابزارهایی برای ترور و ايجاد وحشت بدل شوند.»

در بخش دیگری از بیانیه با اشاره به ممنوعیتهای تسلیحاتی موفق در گذشته از موسسه علوم و فناوری پیشرفته کره جنوبی خواسته شده تا تولید هرگونه تسلیحات مرگبار خودگردان را ممنوع کرده و از کاربرد فناوری هوش مصنوعی در مواردی که برای انسان زیانبار است خودداری کند.

این بیانیه قبل از اجلاس روز دوشنبه در شهر ژنو با شرکت ۱۲۳ کشور عضو سازمان ملل متحد منتشر میشود که قرار است کاربرد فناوری هوش مصنوعی در عرصه تسلیحات و یا به قول منتقدان «روباتهای قاتل» را بررسی کند.

«کایست»، موسسه علوم و فناوری پیشرفته کره جنوبی به سرعت به این بیانیه واکنش نشان داد. رییس دانشگاه در مخالفت با تحریم گفت که این آزمایشگاه «به هیچ وجه در زمینه تولید تسلیحات خودگردان و یا روباتهای قاتل فعالیت نخواهد کرد.»

او افزود این دانشگاه کاملا از نگرانیهای اخلاقی در مورد هوش مصنوعی مطلع است و «یکبار دیگر تاکید میکنيم که کایست هیچ گونه پژوهشی که برخلاف حرمت انسان باشد از جمله در زمینه سلاحهای خودکار بدون کنترل واقعی انسان انجام نخواهد داد.»

این دانشگاه اعلام کرد که مرکز پژوهشی جدید برای تلفیق دفاع ملی و هوش مصنوعی در عرصههایی از جمله فرماندهی و سامانه کنترل، دریانوردی و زیردریاییهای خودران، آموزش هوانوردی و تجسس هوایی هوشمند و ردیابی اشیا تمرکز خواهد کرد.

خبرگزاری رویترز میافزاید کارشناسانی که بیانیه تحریم را امضا کردهاند قانع نشدهاند.

توبی والش پروفسور یکی از دانشگاههای استرالیا که مبتکر و سازمان دهنده این تحریم است گفت واکنش سریع دانشگاه کره جنوبی یک موفقیت بوده ولی قبل از لغو این تحریم باید با تمامی امضا کنندگان بیانیه صحبت کند.

او افزود: «موسسه علوم و فناوری پیشرفته کره جنوبی در دو زمینه مهم عقبنشینی کرده است، یکی عدم تولید تسلیحات خودمار و دیگری تضمین کنترل واقعی انسان بر روباتهاست.»

با این همه پروفسور والش گفت معلوم نیست چگونه میتوانند کنترل واقعی انسان بر یک زیردریایی خودکار در زیر آب را که یکی از طرحهای این مرکز پژوهشی است، تضمین کنند.

او گفت استفاده از روبات و هوش مصنوعی در عرصه نظامی به طور بالقوه میتواند محاسن فراوانی داشته باشد مثل استفاده از روبات به جای انسان برای پاکسازی میادین مین.

«ولی ما نباید تصمیمگیری در مورد این را که چه کسانی باید زنده بمانند و یا بمیرند به یک ماشین بسپاریم. این عبور از یک خط اخلاقی کاملا واضحی است. نباید به روباتها اجازه داد که در مورد مرگ و زندگی تصمیم بگیرند.»